在DeepSeek-V4备受瞩目之际,DeepSeek联合清华大学、北京大学提前释放了一项重磅技术成果:DualPath推理系统。作为深耕AI基础设施的技术服务商,智核科技认为,这一创新虽非模型本身,却可能更具产业意义——它直指智能体(Agent)规模化部署的核心瓶颈,为AI应用从"对话"向"行动"的范式转移奠定了工程基础。

一、智能体场景的工程挑战:当算力不再是瓶颈

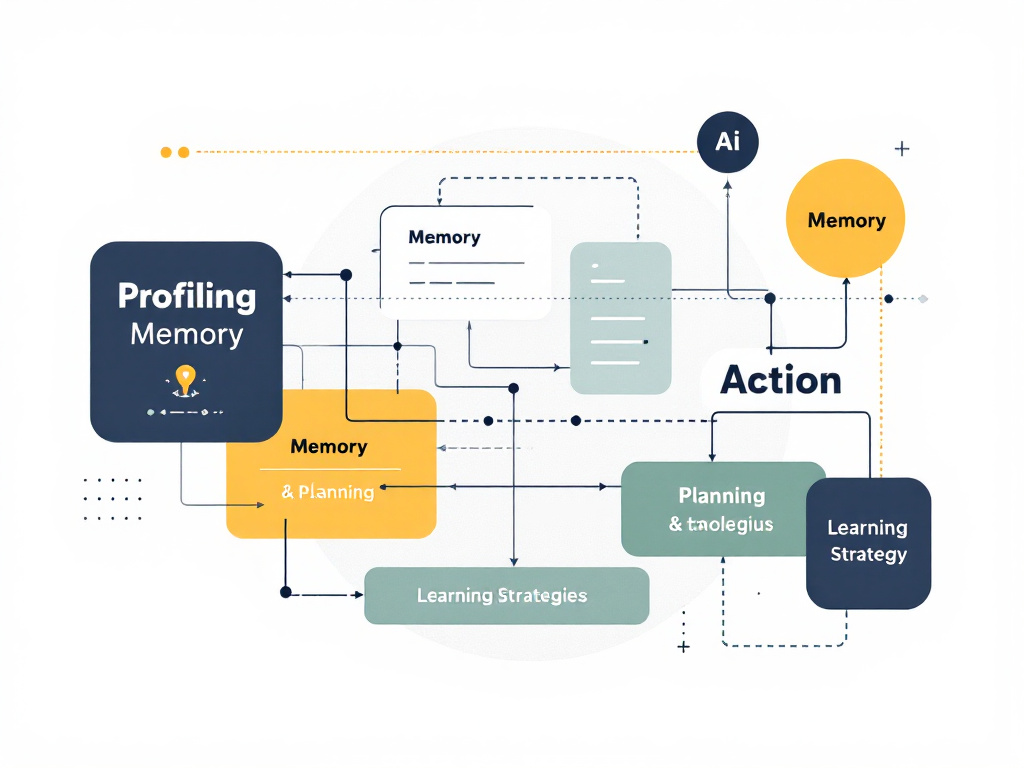

智核科技观察到,AI产业正经历从"大模型"到"智能体"的范式转移。传统对话交互只需"输入-思考-输出"的简单循环,而智能体需与环境持续交互:调用浏览器、执行代码、对接外部系统。交互轮次从几次飙升至几十次、上百次,上下文如滚雪球般膨胀至数十万token。

这种"多轮次、长上下文、短追加"的特征,带来了独特的工程难题。KV-Cache机制虽能避免重复计算(如同追剧时记住前文剧情),但命中率高达95%-99%的背后,隐藏着严峻的存储带宽瓶颈——GPU计算新一轮交互只需不到1毫秒,却需先从存储搬运几十GB的KV-Cache数据。算力成了"大厨",存储却成了"慢助手"。

二、PD分离架构的资源错配:被忽视的闲置产能

当前业界普遍采用的"预填充-解码分离"(PD分离)架构,在智能体场景下暴露结构性缺陷。预填充引擎处理海量输入时存储网卡过饱和,而解码引擎生成回答时存储网卡却大量闲置。这种"进货门堵死、出货门空荡"的资源错配,在算力成本高昂的今天,构成了极大的浪费。

智核科技认为,这一问题的根源在于架构设计的静态思维——将GPU集群机械划分为两个"部门",却未考虑智能体场景下动态变化的负载特征。当预填充引擎被数据搬运拖垮时,解码引擎的计算网络带宽却未被充分利用。

三、DualPath的创新逻辑:网络隔离特性的创造性应用

DualPath的核心洞察在于重新发现硬件潜力。现代AI数据中心(如英伟达DGX SuperPOD)普遍具备网络隔离特性:GPU配备高带宽计算网卡(Compute NIC)用于卡间通信,以及相对低速的存储网卡(Storage NIC)用于数据读写。

DualPath的巧妙之处在于"明修栈道,暗度陈仓":

第一步:让闲置的解码引擎利用其存储网卡,从硬盘/分布式存储拉取KV-Cache数据到本地内存

第二步:利用解码引擎与预填充引擎之间高带宽的计算网络,将数据快速传输至目标位置

这一设计将解码引擎从"单纯的生成者"转变为"数据搬运的协作者",实现了存储带宽的负载均衡,大幅提升了GPU集群的整体利用率。

四、智核启示:工程优化与模型能力的协同进化

DualPath的发布揭示了AI基础设施演进的重要趋势:模型能力的突破,需要工程架构的同步革新。当行业聚焦于参数规模与训练算力时,推理阶段的系统优化同样决定技术落地的深度与广度。

对于智核科技的企业客户,这一案例提供三重启示:

架构层面:评估现有推理基础设施是否适配智能体场景的特征,避免"算力过剩、带宽不足"的结构性失衡;

资源层面:重新审视硬件资源的利用模式,挖掘网络隔离、内存层次等特性中的优化潜力;

生态层面:关注产学研协同创新模式,DeepSeek与顶尖高校的合作表明,工程突破往往源于学术前沿与产业需求的深度耦合。

智核科技认为,智能体的真正普及,不仅依赖模型智能的提升,更取决于推理成本的持续下降与响应速度的实时保障。DualPath架构的推出,标志着中国AI团队在基础设施层面的创新实力,也为全球智能体生态的发展贡献了关键工程方案。在AI从"能说"走向"能做"的进程中,这类底层创新将成为决定产业格局的关键变量。